„Künstliche Intelligenz hat das Potenzial, unsere Freiheit unumkehrbar abzuschaffen“

Herr Pfeffer, Sie schreiben in Ihrem Buch, dass die künstliche Intelligenz die Demokratie gefährdet und zu einer Polarisierung und Radikalisierung der Gesellschaft beiträgt. Ist es wirklich schon so schlimm?

Matthias Pfeffer: Sie können das jeden Tag beobachten. Ich will gar nicht den vielfach benutzten Modebegriff der gesellschaftlichen Spaltung bemühen. Aber unsere öffentliche Kommunikation hat sich durch die Digitalisierung verändert und in den letzten Jahren noch stärker durch den Einsatz von künstlicher Intelligenz. KI und Algorithmen führen zu einer Blasenbildung und stärken einige Meinungen, wie sie andere schwächen. Und wir informieren uns überwiegend, wenn nicht sogar ausschließlich über Kanäle, in denen solche Mechanismen am Werk sind. Und wir tun das relativ naiv, weil wir immer noch nicht verstehen, was da mit uns passiert. Wer trifft denn die Auswahl der Nachrichten, die uns erreichen? Wer überprüft die Quellen? Früher haben sich diese Fragen noch die Journalisten gestellt. Die haben gelernt, wie man Fakten prüft und wie man Meinungen von Fakten sowie Wissen von Behauptungen trennt. Diese Aufgabe haben wir nun Maschinen übergeben. Und leider sehr dummen Maschinen.

Die aber offensichtlich sehr mächtig sind …

Ja, sie sind sehr gut darin, Menschen zu „erkennen“. In Folge kreieren sie Profile basierend auf persönlichen Daten und senden ihnen die „passenden“ Nachrichten zu. Dabei geht es jedoch nicht darum, Sie als Mensch zu informieren. Vielmehr will Sie die Maschine manipulieren – im Idealfall zu einem Kauf oder der Herausgabe von weiteren Daten verleiten. Und das tun diese Maschinen auf sehr raffinierte Art und Weise, die uns als User häufig überfordert; wir verwenden diese Technologie zwar gerne – sie ist auch unheimlich bequem –, aber wir verstehen sie eben kaum.

Niemand wird gerne manipuliert. Müssen wir Menschen vor diesen Maschinen oder künstlicher Intelligenz Angst haben?

Es kommt immer darauf an, wo, zu welchem Zweck und in welchem Umfang diese Systeme eingesetzt werden. „Künstliche Intelligenz“ ist ein Oberbegriff und wird immer auch in Verbindung mit vielen anderen digitalen Technologien benutzt.

Grundsätzlich aber müssen Sie vor künstlicher Intelligenz keine Angst haben, denn Angst suggeriert, dass da ein bewusstes Wesen am Werk ist, das uns irgendwie übel mitspielen will.

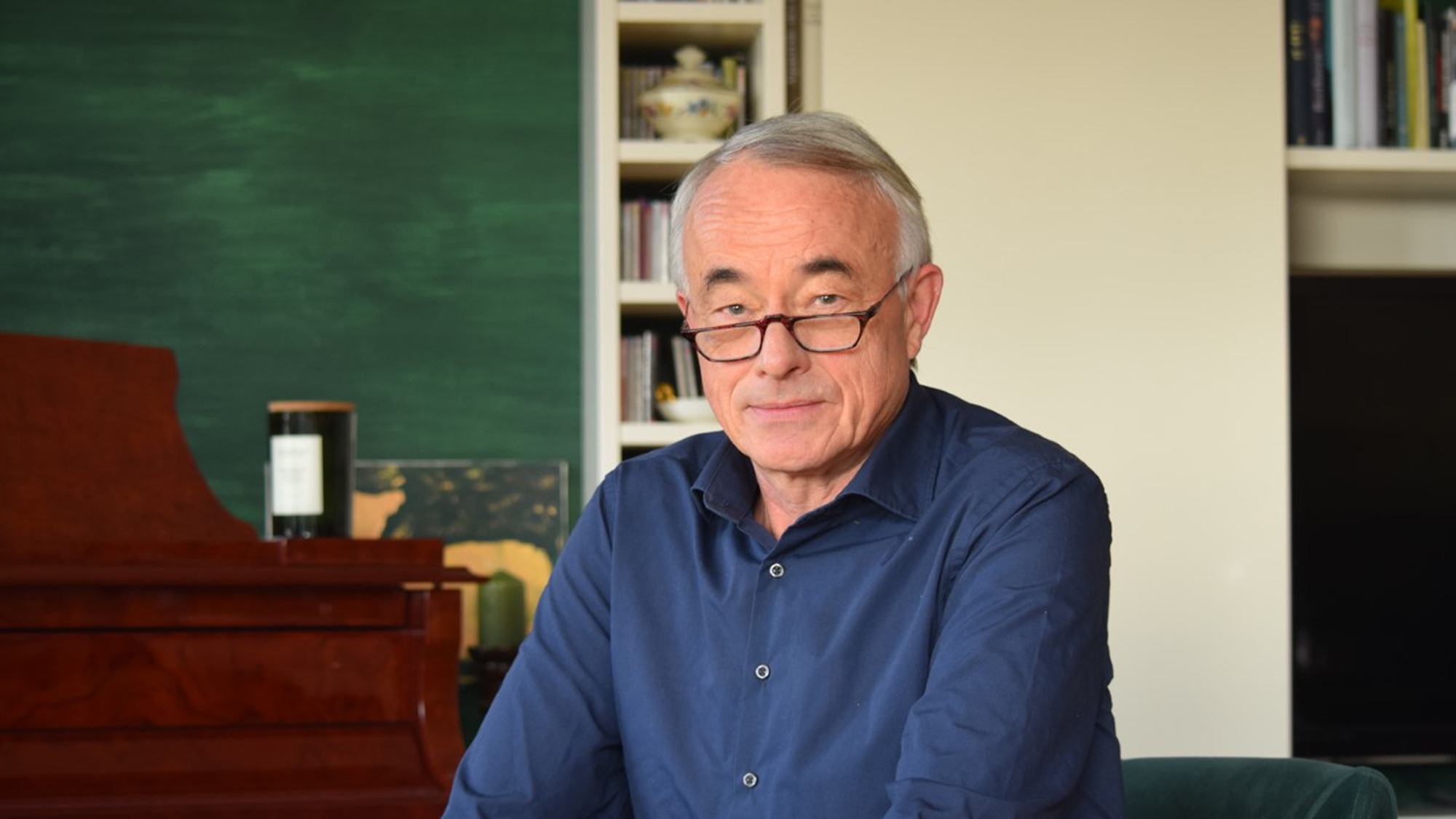

Matthias Pfeffer

Künstliche Intelligenz ist erst einmal eine Technik. Doch wir Menschen schaffen Technologie, die uns zunehmend als etwas gegenübertritt, das wir nicht mehr vollständig verstehen und beherrschen. Oder eben nur noch sehr wenige von uns. Und darin liegt die Gefahr. Der Begriff der künstlichen Intelligenz lässt vermuten, dass die Maschinen tatsächlich intelligent handeln. Doch da sind einfach nur wirklich sehr, sehr schnelle und raffinierte Rechenmaschinen am Werk. Was eigentlich mit intelligentem Verhalten gemeint ist, ist Abwägen, nach Gründen suchen, kritisch sein, die eigene Rolle reflektieren. Und das können nur Menschen leisten.

Menschliches Denken und künstliche Intelligenz

Verlag J.H.W. DietzBedeutet das also, die größte Gefahr ist, dass wir künstliche Intelligenz wirklich für intelligent halten?

Wenn wir auf die Intelligenz der Maschinen vertrauen, kann das für uns gefährlich werden, ja. Nehmen wir den Bereich „autonome Waffen“ bzw. die Waffentechnologie und denken wir darüber nach, was passieren würde, wenn wir hier KI einsetzen. Wenn wir also KI in Waffensysteme integrieren, sodass sie nicht nur den Befehl des Generals ausführen, sondern anfangen, autonom zu werden. Sie also Gefahrensituationen selbsttätig analysieren und die Lösung in Millisekunden umsetzen. Dann haben wir eine völlig neue Situation. Denn Krieg bedeutet die strategische Analyse des Gegners. Das kann eine Maschine nicht leisten und in unserer Zeit, in der atomare Kriegsführung real ist, ist das sehr gefährlich.

Take-aways:

- Künstliche Intelligenz ist nicht intelligent, doch die schnelle Rechenleistung der Maschinen suggeriert uns etwas anderes.

- Kein Unternehmen wird am Einsatz von KI vorbeikommen – der Einzug erfolgt aber oft schleichend, was eine große Gefahr darstellt.

- Wir müssen es schaffen, dass KI ein Instrument bleibt, das wir kontrollieren.

Ist es wirklich nur der Begriff KI, der Menschen glauben lässt, dass diese Maschinen intelligent sind?

Nehmen wir die Geräte, die wir im Alltag nutzen und die uns irgendwie helfen, durchs Leben zu kommen. Wir nehmen sie als Assistenten wahr. Das kann das Navi im Auto sein oder Google, wenn wir etwas wissen wollen. Das ist mittlerweile Alltag. Wir können es uns gar nicht mehr anders vorstellen. Und wir vertrauen auf das, was Google uns anzeigt und das Navi uns sagt. Diese Maschinen sind sehr gut darin, uns Intelligenz vorzuspielen. Und das war von Beginn an das Konzept der KI. Sie wissen heute nicht mehr, ob Antworten von Menschen oder von Maschinen kommen. Nehmen wir den Bankberater, der eigentlich ein Bot ist und Sie zu einer Anlage berät, basierend auf algorithmischen Berechnungen. Oder Sie diskutieren auf Facebook in Bezug auf eine politische Frage und werden durch KI in eine Richtung gelenkt, die eigentlich nicht Ihre ist.

Das heißt, wir müssen viel stärker den Unterschied zwischen Mensch und Maschine betonen, anstatt immer dabei zu bleiben, dass sie scheinbar intelligent und empathisch sind und unser Leben zum Paradies machen werden. Je mehr Vertrauen wir in diese Maschinen haben, desto gefährlicher kann es für uns werden.

Matthias Pfeffer

Wir dürfen das eigene Nachdenken, das kritische Reflektieren nicht abgeben. Sicher ist es toll, mit nur einem Klick eine Antwort zu bekommen, doch diese Bequemlichkeit kann dazu führen, dass unsere eigene Intelligenz gar nicht mehr nötig ist. Das wäre der Supergau. Das heißt, die Überlegenheit der Maschinen würde nicht dadurch kommen, dass eine Superintelligenz auf unserem Planeten landet, sondern dadurch, dass wir einfach schrittweise immer mehr verblöden. Und das meine ich jetzt nicht unbedingt bezogen auf jedes Individuum, sondern insbesondere was den öffentlichen Diskurs bzw. die öffentlichen Entscheidungsfindungen angeht.

Wenn wir von Intelligenz reden, sind auch Themen wie Bewusstsein und Vernunft relevant.

Ich spreche in diesem Zusammenhang von der kalifornischen Ideologie. Die behauptet ja, dass diese „intelligenten“ Maschinen uns überlegen sind. Wir nehmen es einfach hin, dass Entscheidungen von scheinbar „vernünftigen“ Maschinen getroffen werden. Wir sollen das auch nicht hinterfragen. Dieser Behauptung muss man stark entgegentreten. Denn der Begriff der Vernunft beinhaltet sehr viel mehr. Er umfasst all das, was wir als vernünftige oder zumindest vernunftbegabte Lebewesen entwickelt haben, um uns in der Welt zu orientieren. Und das findet auf verschiedenen Ebenen statt: räumliches Denken, musikalische Wahrnehmung und auch ganz viele ästhetische Dinge. Es sind moralische Empfindungen, Gefühle und logische Prozesse, von denen wir gelernt haben, sie so miteinander zu verbinden, dass wir das, was dabei im besten Falle rauskommt, als vernünftig bezeichnen. Und da Maschinen, während sie rechnen, nichts erleben und nichts empfinden, können sie diese Art von Reflexion niemals leisten.

Ich bin überzeugt, dass es besser ist, moralische Entscheidungen halbwegs vernünftig zu treffen, als scheinbar mathematisch logisch optimiert.

Matthias Pfeffer

Künstliche Intelligenz hat ihre Grenzen und die sind durch die Mathematik und die Logik vorgegeben. Die Vorstellungen von der grenzenlosen Macht und dem grenzenlosen Wachstum von KI basieren auf den Aussagen der Wachstumsapostel des Silicon Valley. Es gibt aber kein grenzenloses Wachstum.

Und Ihr Tonfall verrät mir, Sie finden das gut.

Ja, es macht durchaus Sinn, diese Grenzen auch mal als positiv zu sehen. Weg davon, immer Grenzen überschreiten zu wollen. Unbegrenztes mathematisch logisches Wachstum von Intelligenzen ist eine sehr große Fata Morgana.

Wenn wir bei der Mathematik sind, das Wort Algorithmus hat jeder schon einmal gehört. Ich gehe jedoch davon aus, dass, wenn ich zehn Menschen frage, was ein Algorithmus ist, mir acht die Frage nicht beantworten können. Können Sie es?

Der Algorithmus geht auf einen arabischen Mathematiker des Mittelalters namens Al-Chwarizmi zurück. Dieser fand heraus, dass zur Lösung von mathematischen Problemen bestimmte Reihen- und Schrittfolgen hilfreich und notwendig sind. Auf den Alltag übersetzt handelt es sich beispielsweise bei einem Kuchenrezept um einen Algorithmus, Sie bekommen die Zutaten und notwendigen Schritte vorgelegt. Das heißt, Sie kriegen genaue Anweisungen, eine Beschreibung eines Weges, mathematisch und logisch geklärt, wie Sie zu einem bestimmten Ziel kommen. Bei den meisten KI-Systemen wird darauf basierend eine Wahrscheinlichkeit berechnet, dass ein bestimmtes Ergebnis eintritt. Und das funktioniert natürlich sehr viel schneller, als wenn wir Menschen das tun würden.

Algorithmen werden von Menschen geschrieben, dann entwickeln sie sich jedoch – auch dank KI – eigenständig weiter. Wir Menschen haben keinen Einfluss mehr. Das kann doch nicht „gesund“ sein?

Sie sprechen über Deep-Learning-Systeme. In der Geschichte der künstlichen Intelligenz hat man schon einmal gedacht, dass man das menschliche Denken mit Maschinen „nachbauen“ kann. Diesen Gedanken gab man dann frustriert und desillusioniert wieder auf. Aktuell versucht man aber wieder, große Teile unseres Bewusstseins und unseres Denkens mehr oder weniger maschinell nicht nur nachzubauen und zu imitieren, sondern dabei auch noch zu übertreffen. Nehmen wir das Beispiel von dem Schachcomputer, der damals Kasparow besiegt hat. Den hatte man im Vorfeld mit allen vorhandenen Daten zu Schachpartien gefüttert. Und im Spiel hat die Maschine diese Partien einfach unheimlich schnell kombiniert, Wahrscheinlichkeiten berechnet, und darauf basierend wurden die Figuren gesetzt. Google hat dies später mit AlphaGo noch einmal übertroffen: Sie haben den koreanischen Meister des Spiels Go gegen ihre KI antreten lassen – und selbst die Programmierer, also die „Väter“ von AlphaGo, schauten fassungslos zu, mit welchen unerwarteten Zügen die Maschine agierte und schlussendlich gewann. Die Maschine kann einfach so viele Schritte im Voraus berechnen, dass sie gewissermaßen einen göttlichen Blick auf das Spielfeld bekommt, und das sorgt für ihre Überlegenheit.

Womit wir wieder bei der künstlichen Intelligenz sind, die nicht intelligent ist.

Diese Maschinen sind unheimlich schnell und unheimlich mächtig. Wir müssen wirklich ganz bewusst unterscheiden zwischen dem Phänomen des Bewusstseins und den Fähigkeiten dieser Maschinen. Diese sind gigantisch und unterstützen die Wissenschaft und Forschung. KI wird uns das Feld des Wissens neu erschließen helfen.

Sie muss aber ein Instrument bleiben, ein Instrument, das wir kontrollieren.

Matthias Pfeffer

Es darf nicht passieren, dass wir Menschen zum Instrument der Maschinen werden. Wie gesagt, schon heute manipulieren sie uns und treffen für uns Entscheidungen in einer Geschwindigkeit, die wir nicht nachvollziehen können. Das ist ein schleichender Kontrollverlust. Und sollte so eine Maschine wirklich einmal – wie einige denken und andere hoffen – eine generelle Superintelligenz erreichen, ist das das einschneidendste Erlebnis der Menschheitsgeschichte.

Aber lässt sich diese Entwicklung wirklich noch aufhalten?

Ja, auf jeden Fall. Aktuell sitzen wir noch am Steuer. Es entscheidet keine künstliche Intelligenz, sondern wir als Mensch und Gesellschaft. Wir müssen Regulierungen und Gesetze einführen, wie damals in den 1960er-Jahren für die chemische Industrie, die die negativen Folgen der Technik eingrenzen. Und das kann in einem Zeitalter der Globalisierung nur international geschehen. Die Gefahr ist, dass es genau deshalb zu lange dauert und die Technik schneller sein wird als wir Menschen.

Auf der einen Seite haben viele Menschen Angst, dass ihnen KI den Job wegnimmt, auf der anderen Seite aber lassen sie beispielsweise Alexa oder Google Home schon Entscheidungen für sie treffen. Und auch im Gesundheitssektor kommt KI schon zum Einsatz.

Und hier zeigt sich, dass KI seine Grenzen hat. Nehmen wir ein aktuelles Beispiel aus den USA. Hier sollte ein Algorithmus berechnen, wie die Corona-Impfstoffe zu verteilen sind. Einfach, fair und gerecht, wie es hieß. Es stellte sich jedoch schnell heraus, dass die Leute, die die Impfdosen zuerst bekamen, reiche weiße Amerikaner waren. Die KI hat einfach für sich entschieden, dass diejenigen, die am meisten in den Apotheken zu finden sind, am bedürftigsten sind. Und das passiert eben, wenn der Mensch die von der Maschine auf mathematischer Basis berechneten Entscheidungen nicht mehr hinterfragt oder überprüft. Hier kommt auch das Thema Haftung und Transparenz mit ins Spiel. Es darf nicht dazu kommen, dass sich die Hersteller am Ende damit rausreden, dass sie ja selbst nicht sagen konnten, was die Maschine für Ergebnisse ausspuckt, und deswegen vielleicht Menschenleben gefährdet werden.

Wenn wir bei der Anwendung sind: Ich sehe immer wieder Unternehmen, in denen mit Begeisterung davon gesprochen wird, jetzt auch KI einzuführen. Und schaut man ein halbes Jahr später noch einmal nach, ist da nichts passiert.

Und manchmal passiert eben doch etwas. Das ist wie damals mit der EDV. Im Falle von selbst lernender KI bemerken Sie den Übergang zu weiteren Stufen nicht einmal selbst, er geschieht schleichend.

Machen Sie sich immer bewusst, wo Sie Ihre Hoheit, Ihre Autonomie, Ihre Selbstbestimmung nur ein Stück aus der Hand und an eine Maschine abgeben.

Matthias Pfeffer

Auf der anderen Seite hat die aktuelle Entwicklung auch etwas sehr Positives. Wir Menschen reflektieren wieder stärker. Stellen Fragen wie: Was macht uns als Menschen eigentlich aus? Was ist Vernunft im Gegensatz zu einer künstlichen Intelligenz? Und was sind unsere Moral und unser Rechtssystem wirklich?

Sie würden also jedem Unternehmen, das KI einführen bzw. nutzen möchte, zu einer kritischen Haltung raten?

Auf jeden Fall. Seien Sie immer vorsichtig bei dem, was man Ihnen verspricht. Hinterfragen Sie sehr genau, zu welchen Zweck die KI an dieser Stelle eingesetzt wird. Sie werden als Unternehmen nicht darum herumkommen, zukünftig die Steuerung Ihrer Organisation zu einem gewissen Teil an KI-Systeme abzugeben. Gerade die großen Organisationseinheiten werden immer stärker auf Algorithmen setzen. Viele Wirtschaftsbereiche sind bereits datengetrieben, und „Big Data“ werden Sie nur mit Algorithmen bearbeiten können. Es gibt hier keine Alternative.

Kommen wir noch einmal auf die Regulierungen zu sprechen. Sie schreiben in Ihrem Buch, dass hier die Politik gefragt ist. Wie sieht das in Ihren Augen aus?

Es braucht eine klare Gesetzgebung, die eben auch berücksichtigt, dass sich solche Technologien wahnsinnig schnell entwickeln. Man darf nicht den Fehler machen, nur auf Missstände zu reagieren.

Mit der zeitlichen Verzögerung, die durch den politischen Prozess begründet ist, kommt man immer zu spät. Wir haben diese Erfahrung schon mit Social Media gemacht. Plötzlich haben wir Probleme, die auch Auswirkungen auf unsere Demokratie haben.

Matthias Pfeffer

Wir müssen aus diesem Grund vorbeugende Maßnahmen ergreifen, um so etwas wie Freiheit und Meinungsvielfalt sicherzustellen und auf Dauer zu sichern. Das ist die Aufgabe der gesamten Gesellschaft und der Auftrag des Gesetzgebers. Das hat ja das Bundesverfassungsgericht sogar im Bereich von Klimaschutz mittlerweile so gesehen und gesagt, dass wir, um die Freiheit künftiger Generationen erhalten, viel mehr für den Klimaschutz tun müssen. Erst recht gilt so ein Argument natürlich für die Entwicklung künstlicher Intelligenz. KI hat das Potenzial, die Freiheit unumkehrbar abzuschaffen.

Das klingt etwas nach Weltuntergang.

Die Überwachungs- und Manipulationskraft dieser Technologie ist enorm und wir müssen nicht erst nach China gucken, sondern spüren es auch hier schon. Da ist der Rechtsstaat gefordert. Doch Dinge wie die aktuelle Meldung, dass Facebook anscheinend überlegt, den Dienst in Europa abzuschalten, erfüllen mich dann doch auch mit Hoffnung. Dann wäre endlich mal Raum für Alternativen und für Konkurrenten. Es gibt also immer noch die Herrschaft des Rechts und Facebook muss sich nun entscheiden, ob es den europäischen Standards gerecht werden will oder den laxen amerikanischen.

Wer wäre in Ihren Augen denn eine zentrale Instanz, die den verantwortungsvollen Umgang und Einsatz mit KI sicherstellen könnte?

In der Demokratie sagen wir ja, die zentrale Instanz ist gerade häufig das Problem und wenn nur einer den Hut aufhat, ist das Machtmissbrauch. Die Macht muss daher immer geteilt und kontrolliert werden. Das heißt, wir reden von einem System, in dem Judikative, Legislative und Exekutive getrennt bleiben. Und diese müssen durch die unabhängige Presse kontrolliert werden. Das ist das klassische Prinzip, zu dem es nur autokratische und diktatorische Alternativen gibt. Vielleicht hilft es auch, das Bewusstsein für Freiheit, das wir ja haben, nicht mehr einfach als selbstverständlich zu erachten, sondern wirklich als Verdienst letztlich unserer Geschichte, Kultur, Vorgänger und Vorfahren zu sehen und zu verteidigen.

Ein sehr aktuelles Thema in diesen Zeiten.

Einige Autokraten fühlen sich durch die Schwäche der Demokratie im Augenblick dazu ermutigt, unsere Selbstbestimmung und Rechtsstaatlichkeit zu untergraben. Und ich glaube, dass hier die Technologie eine entscheidende Rolle spielen wird. Und Corona hat der Digitalisierung noch einmal einen richtigen Schub gegeben. Wir haben hier jedoch eine Tendenz zur Monopolisierung. Nehmen Sie Amazon: Die wollen nicht Weltmarktführer, sondern der Markt selbst sein. Schon jetzt machen Weltkonzerne wie eben Amazon, Google und Apple ihre eigenen Gesetze oder spielen sich wie Facebook mit dem Vorhaben einer eigenen Währung als Weltregierung auf. Das können wir aus Gründen des Wettbewerbs nicht akzeptieren, aber vor allem aus Gründen der Meinungsvielfalt und der Demokratie.

Kommen wir also zur letzten Frage: Was kann ich persönlich tun, damit all die von Ihnen angesprochenen Dinge nicht aus dem Ruder laufen?

Denken, nachdenken, kritisch bleiben und sich auch nicht kirre oder klein machen lassen. Ich glaube, wir haben mit unserem Gehirn immer noch eine ganz gute Instanz, zumindest wenn wir uns bemühen. Wir müssen dazu auch nicht erst zu superintelligenten Wesen werden, sondern der gesunde Menschenverstand gepaart mit einem kritischen Reflexionsvermögen und mit einer wirklich an der Sache und an Argumenten orientierten Gesprächskultur ist eigentlich die beste Versicherung, die wir haben, weiterhin unsere Werte und Maßstäbe in der Zukunft geltend zu machen. Ich glaube, wir müssen uns einfach nur wieder aufrappeln und uns klarmachen, dass es nicht darum geht, irgendwelche neuen Grenzen ständig zu überspringen, sondern einfach die Werte, nach denen wir leben wollen, auch in Zukunft noch selbst zu gestalten – auch und vor allem für unsere Nachkommen. Immanuel Kant sagte einmal: „Wage zu denken, habe den Mut, dich deines eigenen Verstandes zu bedienen.“ Das wäre auch mein Ratschlag.

Über den Autor

Matthias Pfeffer hat Philosophie studiert und arbeitet als freier TV-Produzent und Autor. Prinzip Mensch hat er gemeinsam mit seinem Studienfreund, dem Juristen und Hauptberater der EU-Kommission für Justiz Paul Nemitz geschrieben. Das Buch Menschliches Denken und Künstliche Intelligenz, Eine Aufforderung hat er allein verfasst.