KI ist ein Instrument, aber kein Ersatz für Menschen. Gefahr geht nicht von KI selbst aus, sondern von den Profit- und Kontrollinteressen skrupelloser Anwender.

Philosophische Intelligenz entzaubert künstliche Intelligenz

KI hat kein Herz

Auf der World Artificial Intelligence Conference 2019 in Shanghai trafen die prominenten Unternehmer Elon Musk (Tesla) und Jack Ma (Alibaba) in einem Podiumsgespräch aufeinander. Elon Musk behauptete, dass die Nischen, in denen wir Menschen den Computern überlegen sind, immer weiter schrumpfen und dass künstliche Intelligenz (KI) uns bald in jeder Hinsicht überholt haben wird. Jack Ma hielt dagegen, dass wir keine Angst vor Maschinen haben sollten: „Computer haben nur Chips. Menschen haben ein Herz. Es ist das Herz, aus dem Weisheit entspringt.“

KI hat einiges mit Intelligenz zu tun, aber kaum etwas mit Verstand und nicht entfernt mit Vernunft.Richard David Precht

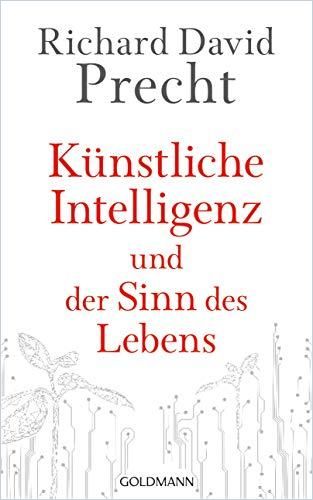

Das Herz macht den Unterschied aus. Kann ein Computer glücklich sein? Kann ein Elektronenhirn Trauer verspüren? Hat ein Rechner Angst vorm Sterben? Auch wenn KI in Schach und Go inzwischen jeden Großmeister schlägt – was ihr fehlt, ist beispielsweise Emotionalität, stellt der Philosoph Richard David Precht in seinem Buch Künstliche Intelligenz und der Sinn des Lebens fest. Menschen haben Emotionen. Emotionen leiten den Verstand und veranlassen uns überhaupt erst zum Handeln. Was bedeutet es, wenn wir erkennen, dass dort ein Baum steht? Nichts. Erst das Bedürfnis, in seinem Schatten zu sitzen oder einen Apfel zu pflücken, verleiht dem Erkennen einen Sinn und lässt uns aktiv werden. KI kann das nicht. Überhaupt sind ihre Daten allenfalls drittklassig. Da ist erstens die objektive Realität. Wir Menschen nehmen bloß einen Teil davon wahr – das ist unsere „Welt aus zweiter Hand“. Wiederum Ausschnitte davon wandeln wir in Bits, Bytes und Algorithmen um und speisen sie in Computer ein. KI ist also lediglich eine „Welt aus dritter Hand“, wie Precht sagt. Sie hat zwar erstaunliche Fähigkeiten, bleibt aber Menschenwerk. KI kennt keine Moral, keine Gemeinschaft, keine Anerkennung und keine Wertschätzung.

Der Zweck der Durchdringung von Welt und Menschen mithilfe von KI ist nicht, Menschenleben besser zu machen, sondern Gewinne zu erzielen und zu steigern.Richard David Precht

Prechts kritischer Blick dringt noch sehr viel tiefer. Er schaut dorthin, wo er Gefahren verortet, die oft weniger von der KI als von ihren Anwendern ausgehen, etwa von Profitinteressen und Geheimdiensten, die uns unserer Privatsphäre und Intimität berauben. So kratzt er am Selbstverständnis des kapitalistischen Wirtschaftssystems. Dabei ist der Philosoph durchaus kein Technikmuffel. Im letzten Kapitel zeigt er, dass er auch den Nutzen dieser Technologie sieht. Bis dahin freilich stößt er eine Menge denkenswerter Gedanken an.

Profitgier statt menschlicher Bedürfnisse

Zurück zur Konferenz in Shanghai. Elon Musk sprach auch über seine Pläne, das menschliche Gehirn mit Computern zu verbinden, woran seine Firma Neuralink arbeitet. Und er erläuterte, dass er Menschen mit SpaceX zum Mars schicken will, um das Überleben unserer Spezies zu sichern, falls uns auf der Erde etwas zustoßen und das Leben ausgelöscht werden sollte.

Der Gedanke, Menschen irgendwo in den unwirtlichen Weiten des Weltalls anzusiedeln, scheint IT-Gurus und Techno-Utopisten näher zu sein, als den Lebensstil der Industrienationen auch nur sanft anzuzweifeln.Richard David Precht

Auf die „Hohepriester des Silicon Valley“ ist Precht gar nicht gut zu sprechen. Derartige Ideen und Geschäftsmodelle werden munter vorangetrieben und folgen dem entfesselten kapitalistischen Streben nach immer mehr, wobei die Umwelt bestenfalls Ressource ist. Doch warum soll der Mensch dem Rechner unterlegen sein und daher zum Cyborg werden, indem man sein Bewusstsein mit Computern verschmilzt? Eine notwendige Begründung unterbleibt. Hinter dieser Hybris stecken laut Precht lediglich Geschäftsinteressen, eine dumpfe Innovationsideologie und „diktatorischer Fortschrittszwang“, die geflissentlich übersehen, dass nicht jede Innovation Fortschritt bedeutet. Wenn der Fokus permanent in eine unbestimmte Zukunft gerichtet wird, wo bleibt da unsere Gegenwart? Statt Menschen auf dem Mars überleben zu lassen, könnten Hightechunternehmer ja auch mal darüber nachdenken, wie sie mit der Erde umgehen sollten, damit die Menschheit hier fortbestehen kann.

Science-Fiction und Hollywood

Im Kapitel „Die böse Maschine“ nimmt Precht von Science-Fiction-Büchern und Hollywood-Filmen geschürte Fantasien aufs Korn, etwa dass eine Superintelligenz die Menschheit ausrotten oder die Macht an sich reißen und die Weltpolitik bestimmen wolle. Aber warum sollte sie solche expansiven, egoistischen und rücksichtslosen Ziele verfolgen, wenn sie intelligent ist? Sie würde sich wahrscheinlich klügeren Zielen widmen, zumal sie nichts weiter braucht als Energie. Sie könnte, so Precht, „dem Müßiggang frönen, den Kapitalismus überwinden und völlig selbstlos werden.“ Andererseits – und dies ist eine köstliche Pointe – könnte sie auch zu dem Schluss gelangen, dass es für die Menschen mit ihrer ständigen Unzufriedenheit und Aggressivität besser wäre, wenn es sie gar nicht gäbe. Die Superintelligenz würde dann die Menschheit abschaffen, nicht weil sie böse, sondern weil sie wohlmeinend ist.

KI ohne Sinn und Moral

Scharfsinnig seziert Precht viele Aspekte von KI. Auf falschen Pfaden wandelt die Diskussion etwa beim Thema autonomes Fahren. Nicht nur wird hier die informationelle Selbstbestimmung mit Füßen getreten. Auch missachten „Todesalgorithmen“ die Menschenwürde, wenn IT-Experten – ausgerechnet! – sich Gedanken darüber machen, welche Menschenleben in brenzligen Verkehrssituationen wohl eher geopfert werden können. Wiederum sieht Precht massive Geschäftsinteressen am Werk, wenn uns vorgegaukelt wird, dass unsere Mobilität autonomes Fahren zwingend erfordere, statt die Mobilität selbst zu hinterfragen. Weniger Verkehrsopfer könnten wir zum Beispiel auch durch weniger Verkehr erreichen.

Wenn bereits beim Straßenverkehr (!) die Menschenwürde hintangestellt werden kann, wo denn sonst noch?Richard David Precht

KI kann nie wie Menschen sein. Dafür sind wir zu individuell und verhalten uns zu unlogisch. Moral lässt sich nicht digitalisieren, weil sie immer von der Situation, den Rahmenbedingungen und auch von der Kultur bestimmt wird. Obendrein existieren zwischen Gut und Böse viele Abstufungen. Sinn ist nicht logisch, sondern etwas, das man fühlt. Sinn ist wichtig für die Identität eines jeden einzelnen Menschen – programmierbar ist er nicht.